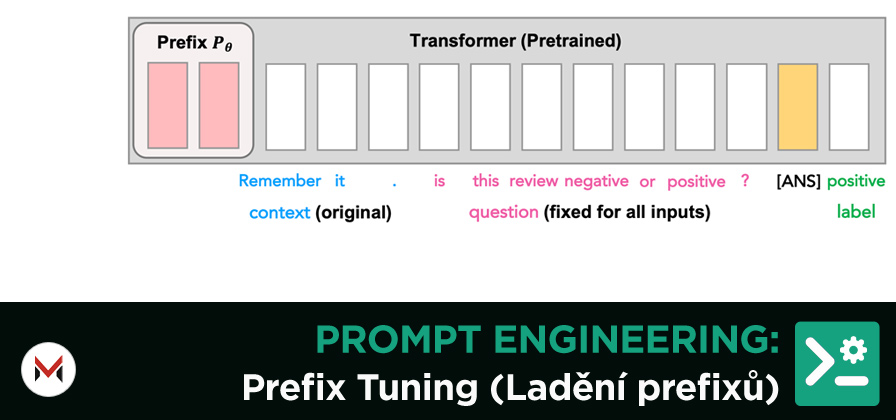

Na tomto obrázku je ilustrován způsob, jakým se umělá inteligence učí specifické úkoly, jako je psaní textu o kavárnách Starbuks.

Představte si, že máte velmi chytrého robota, který už se naučil dělat spoustu věcí, ale teď chcete, aby se stal expertem na psaní o kavárnách. Učíte ho, dáváte mu spoustu příkladů a on se z těchto příkladů učí. Nakonec se naučí psát skvěle o kavárnách. To je Fine-tuning – specializovaný trénink na určitý úkol.

Nyní si představte, že místo toho, abyste robota učili od začátku, dáte mu klobouk s nápisem „Expert na kavárny Starbugs“. Když si klobouk nasadí, najednou začne mluvit o kavárnách, protože klobouk mu připomene, co by měl dělat. Nemusíte ho nic učit; klobouk mu dá vědět, že by měl používat vše, co už ví, ale teď to aplikovat na kavárny. To je Prefix-tuning – dáváte AI návod, co má dělat, aniž byste museli cokoli měnit v tom, jak myslí.

Představte si zkušeného kuchaře, který umí uvařit cokoliv. Místo toho, abyste ho posílali znovu do školy pokaždé, když chcete nový recept, prostě mu dáte lístek s instrukcemi: „Dnes vaříme thajsky.“ Kuchař je pořád ten samý, jen dostal nový pokyn. Přesně takhle funguje Prefix Tuning — AI model zůstává beze změny, jen dostane krátkou „instrukční kartičku“, která ho nasměruje na konkrétní úkol.

Proč vůbec potřebujeme Prefix Tuning?

Velké jazykové modely (například GPT nebo Claude) jsou universální — umí trochu od všeho, ale na žádný konkrétní úkol nejsou specialisté. Když chcete, aby model exceloval třeba ve shrnutí článků nebo v odpovídání na dotazy zákazníků, musíte ho nějak „doladit“. Historicky existovaly dvě cesty:

První cesta je kompletní přeškolení (Fine-tuning). To znamená, že vezmete celý obří model a změníte všechny jeho parametry — miliardy čísel, ze kterých se skládá. Je to účinné, ale extrémně drahé a pomalé. Druhá cesta je Prefix Tuning, který v roce 2021 představili výzkumníci Xiang Lisa Li a Percy Liang ze Stanfordovy univerzity. Jejich nápad byl jednoduchý: co kdyby model zůstal tak, jak je, a my jen přidali krátkou instrukci na začátek?

Jak to funguje — bez technického žargonu

Představte si firmu, která potřebuje AI na tři úkoly: shrnutí e-mailů, překlad do angličtiny a odpovídání na dotazy zákazníků. Při klasickém fine-tuningu potřebuje tři kompletní kopie obřího modelu — každou speciálně přeškolenou. To je jako kupovat tři stejné dodávky a každou přestavovat pro jiný účel.

S Prefix Tuningem stačí jedna dodávka a tři různé navigace. Model je jeden a prefixy jsou tři malé soubory. Když chcete shrnout e-mail, „připnete“ na začátek vstupu prefix pro shrnutí. Když chcete přeložit, připnete jiný prefix. Model se vůbec nemění — mění se jen ta krátká instrukce na začátku.

Co je vlastně ten „prefix“?

Tady je důležité rozlišit dvě věci. Prefix v běžném jazyce znamená předponu — třeba „před-“ ve slově „předpona“. Ale v Prefix Tuningu to není text, který byste napsali na klávesnici.

Prefix je sada čísel, kterou si model vytvoří sám během tréninku — tedy v rámci procesu strojového učení. Představte si to jako tajný jazyk mezi prefixem a modelem. Vy jako uživatel ten prefix nikdy nevidíte ani nepíšete. Vzniká automaticky tak, aby model co nejlépe pochopil, co po něm chcete. Je to něco jako noty v partituře — pro nemuzikatna vypadají jako čáry a tečky, ale orchestr z nich přečte celou symfonii.

Čísla, kterým porozumíte

Proč je to tak revoluční? Podívejte se na konkrétní srovnání:

GPT-3 má 175 miliard parametrů. Při klasickém fine-tuningu měníte všech 175 miliard. Při Prefix Tuningu ladíte jen přibližně 0,1 % z nich — tedy zhruba 175 milionů. To stále zní jako hodně, ale je to jako byste z celé Prahy přestavovali jen jeden blok domů místo celého města. Tento přístup spadá do rodiny technik označovaných jako parameter-efficient fine-tuning (PEFT), mezi které patří i populární metoda LoRA.

V praxi to znamená:

- Tisícinásobně menší nároky na paměť — nepotřebujete ukládat celou kopii modelu pro každý úkol, jen ten malý prefix.

- Výrazně nižší náklady — místo pronájmu superpočítače na týdny vám stačí zlomek výpočetního výkonu.

- Srovnatelné výsledky — výzkumníci prokázali, že Prefix Tuning dosahuje podobné kvality jako kompletní přeškolení, a to i na náročných úkolech, jako je generování textu nebo shrnutí.

K čemu je to dobré v praxi?

Díky Prefix Tuningu si dnes menší firmy mohou přizpůsobit velké AI modely pro své potřeby, aniž by investovaly miliony do výpočetního výkonu. Jeden model může v pondělí shrnovat smlouvy, v úterý překládat a ve středu analyzovat recenze zákazníků — stačí přepnout prefix. Pokud chcete Prefix Tuning vyzkoušet v praxi, k dispozici je GitHub repozitář s původní implementací i knihovna PEFT od Hugging Face, která Prefix Tuning integruje společně s dalšími PEFT metodami.

Příklady využití v praxi:

- E-shopy — jeden model s různými prefixy generuje popisky produktů, odpovídá na dotazy zákazníků i vytváří marketingové texty.

- Právní kanceláře — stejný model shrnuje smlouvy, vyhledává relevantní judikaturu a připravuje podklady pro jednání.

- Redakce a média — model s prefixem pro korekturu opravuje texty, s jiným prefixem je překládá a s dalším generuje titulky článků.

Jak se Prefix Tuning liší od promptingu?

Možná vás napadá otázka: „Není to totéž jako napsat dobrý prompt?“ Ne tak docela. Když píšete prompt (textový příkaz), jste omezeni slovy a větami, které model zpracuje jako běžný text. Prefix Tuning jde hlouběji — pracuje přímo s vnitřní řečí modelu, s čísly, která ovlivňují jeho chování na úrovni, kam se textovým příkazem nedostanete. Více o tom, jak funguje klasické promptování, najdete v průvodci prompt engineeringem.

Srovnejte si to takhle: prompt je jako když turistovi řeknete česky „jděte rovně a pak doprava“. Prefix Tuning je jako když mu přímo vložíte do hlavy znalost mapy celého města. Výsledek je přesnější, stabilnější a lépe opakovatelný. Technická dokumentace metody je k dispozici na stránkách Hugging Face PEFT.

Závěr

Prefix Tuning ukazuje, že nemusíte přestavět celý dům, když chcete změnit výhled — stačí vyměnit okno. Je to jedna z metod, díky kterým se velké modely umělé inteligence stávají dostupnějšími a praktičtějšími pro běžné použití. Více o práci s umělou inteligencí se dozvíte v našem průvodci. A co je nejdůležitější — otevírá dveře firmám a jednotlivcům, kteří si dosud nemohli dovolit přizpůsobovat AI svým potřebám.

Další čtení: Pokud vás zajímá širší kontext efektivního dolaďování modelů, doporučujeme přehledný článek na platformě Learn Prompting nebo původní paper prezentovaný na konferenci ACL 2021.