Když AI myslí a jedná zároveň

Představte si zkušeného detektiva při práci. Nestojí na místě a nepřemýšlí o případu čistě v hlavě – pohybuje se, sbírá důkazy, každý nový nález mění jeho hypotézu, ta hypotéza ho vede k dalšímu kroku, ten krok přináší nové informace. Uvažování a jednání se u něj prolínají do jednoho plynulého procesu. Přesně tento princip stojí za technikou promptingu nazvanou ReAct – zkratka z anglického Reasoning and Acting, tedy Uvažování a jednání.

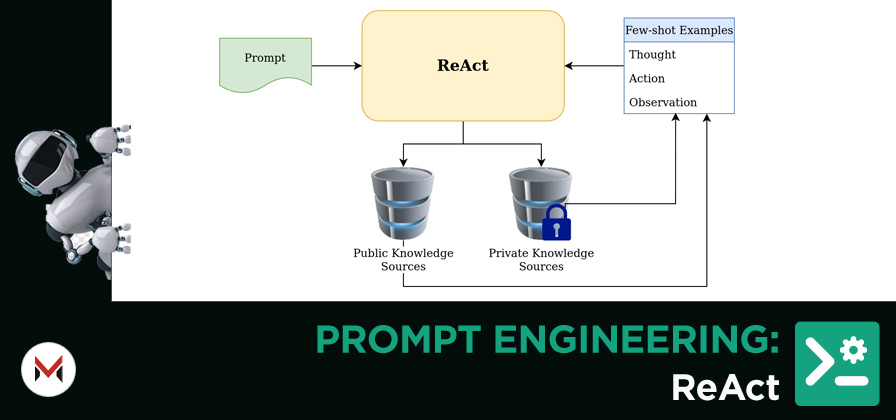

ReAct je technika založená na principu rekurzivní aplikace promptů na výstupy modelu. To znamená, že výstup generovaný modelem na základě jednoho promptu se používá jako nový prompt pro další generování výstupu. Tento proces může být opakován, aby se dosáhlo hlubšího a komplexnějšího výstupu.

Techniku představili Yao a kolegové v roce 2022 v rámci, kde jsou velké jazykové modely využívány k prokládanému generování stop uvažování a akcí specifických pro danou úlohu.

Kde selhávají tradiční přístupy?

Technika Chain-of-Thought (CoT) – myšlenkový řetězec – ukázala, že LLM dokáží postupovat krok za krokem a vykazovat kvalitní uvažování u aritmetických i logických problémů. Má však zásadní omezení: model pracuje výhradně se znalostmi, které má uloženy z tréninku. Nemůže ověřit fakta, nemůže sáhnout po aktuálních informacích a nemůže opravit svůj směr uvažování na základě dat z vnějšího světa. Výsledkem jsou takzvané halucinace – přesvědčivě znějící, ale fakticky nepravdivé odpovědi – a šíření chyb, kdy jeden chybný předpoklad zkazí celý řetězec závěrů.

ReAct tento problém řeší tím, že do procesu uvažování vkládá akce: kroky, při nichž model aktivně vyhledává informace v externích zdrojích – databázích, encyklopediích, nástrojích nebo jiných systémech – a výsledky těchto akcí okamžitě zapracuje do dalšího uvažování.

Jak ReAct funguje?

Průběh ReAct lze popsat jako cyklus čtyř opakujících se kroků. Model nejprve formuluje myšlenku – uvažuje o tom, co ví a co potřebuje zjistit. Na základě této myšlenky definuje akci – konkrétní dotaz nebo příkaz k externímu nástroji či zdroji. Akce je provedena a model obdrží výsledek pozorování z vnějšího světa. Toto pozorování se stává vstupem pro další kolo uvažování, které opět vede k nové myšlence, nové akci a novému pozorování.

Tento cyklus se opakuje tak dlouho, dokud model nenajde dostatečné informace pro formulaci finální odpovědi. Na rozdíl od CoT, kde model „myslí v bublině“, ReAct model neustále uzemňuje v realitě prostřednictvím externích dat. Každý krok uvažování je okamžitě konfrontován se skutečností.

Uvažování a jednání: proč jde o synergii, ne o součet

Klíčový insight autorů spočívá v tom, že uvažování a jednání se vzájemně posilují – nejde jen o jejich prostý součet. Uvažování umožňuje modelu vyvolávat, sledovat a průběžně aktualizovat akční plány. Díky tomu může reagovat i na nepředvídané okolnosti a výjimky, které by čisté CoT uvažování zaskočilo. Jednání zase přináší do procesu uvažování nová data, která by model sám ze svých tréninkových znalostí nikdy nevygeneroval.

Výsledkem je systém, který dokáže to, co u AI modelů jinak bývá vzácné: přiznat si mezeru ve znalostech, aktivně ji zaplnit a pokračovat ve správném směru. Model v ReAct paradigmatu říká v podstatě: „Tohle nevím s jistotou, ověřím to“ – a skutečně to ověří.

Kde ReAct nachází uplatnění?

Výzkum prokázal, že ReAct překonává řadu state-of-the-art modelů v jazykových i rozhodovacích úlohách. Prakticky se technika uplatňuje všude tam, kde nestačí statické znalosti modelu a kde je třeba pracovat s aktuálními nebo specifickými informacemi.

V oblasti hloubkové analýzy textů model nejprve shrne dostupný obsah, na základě shrnutí formuluje dílčí otázky, vyhledá relevantní doplňující informace a teprve poté sestaví komplexní analýzu.

V iterativním řešení problémů – například v matematických nebo technických aplikacích – navrhne obecný postup řešení, ověří dílčí kroky a postupně zpřesňuje výsledek. V oblasti výzkumu a monitoringu může ReAct průběžně vyhledávat aktuální data a integrovat je do probíhajícího analytického procesu.

Zdroj: Yao et al. (2022). ReAct: Synergizing Reasoning and Acting in Language Models.

Žádné související příspěvky.