Nejdřív přeformuluj a pak odpověz

Každý, kdo někdy vedl důležitý rozhovor, zná situaci, kdy si před odpovědí potřebuje v hlavě otázku zopakovat jinak – aby si ověřil, zda ji správně pochopil. Zkušený terapeut přeformuluje klientovu otázku, aby ukázal, že mu naslouchá a rozumí. Dobrý učitel zopakuje studentovu nejasnou otázku srozumitelnějšími slovy. Tato intuitivní komunikační strategie stojí za technikou promptingu nazvanou Rephrase and Respond – přeformuluj a odpověz, zkráceně RaR. Navrhli ji výzkumníci Deng a kolegové z UCLA.

Co je problém, který RaR řeší?

Velké jazykové modely mají jedno nepříjemné slepé místo: interpretují otázky jinak než lidé. Otázka, která je pro člověka naprosto jednoznačná, může být pro model nejednoznačná – a naopak. Tento interpretační nesoulad vede k situacím, kdy model odpovídá přesně a gramaticky správně, ale fakticky mine podstatu toho, na co se člověk ptal.

Tradiční přístupy tento problém řeší tím, že uživatel musí otázku formulovat velmi pečlivě a přesně. RaR obrací odpovědnost: místo toho, aby uživatel musel perfektně formulovat dotaz, nechá model samotný nejprve otázku přeformulovat a rozšířit – a teprve poté na ni odpovědět. Model si tak sám ujasní, co vlastně bylo myšleno, a zodpoví tu správnou verzi otázky.

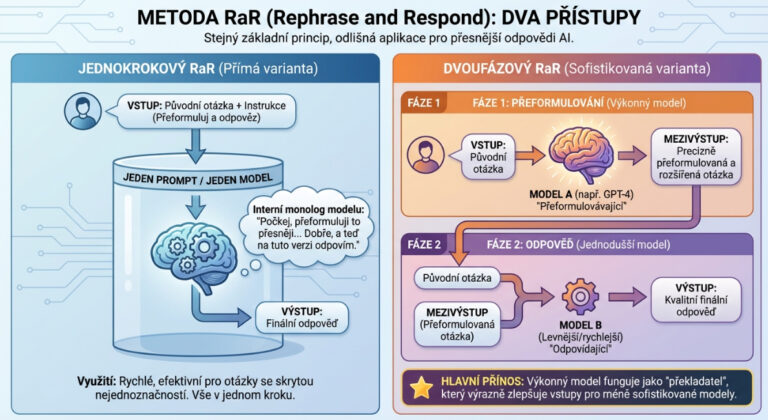

Jak RaR funguje – dva přístupy:

RaR existuje ve dvou formách, které se liší složitostí i způsobem nasazení. Obě vycházejí ze stejného základního principu, ale každá ho aplikuje trochu jinak.

Jednokrokový RaR je jednodušší a přímočařejší varianta. Model dostane otázku spolu s instrukcí, aby ji nejprve přeformuloval vlastními slovy a rozšířil o relevantní kontext – a poté na takto upravenou verzi odpověděl. Celý proces proběhne v rámci jediného promptu. Model v podstatě říká sám sobě: „Počkej, jak by tato otázka mohla znít přesněji? Dobře, a teď na ni odpovím.“ Tato varianta se ukázala jako zvláště efektivní u otázek, které jsou zdánlivě jasné, ale obsahují skrytou nejednoznačnost – typicky u otázek, kde záleží na kontextu nebo implicitních předpokladech.

Dvoufázový RaR je sofistikovanější přístup, který zapojuje do procesu dva oddělené modely nebo dvě oddělené výzvy. V první fázi přebírá roli „přeformulovávajícího“ modelu – ideálně výkonného LLM jako GPT-4 – který otázku přeformuluje a rozšíří. Přeformulovaná verze otázky je poté zkombinována s původní otázkou a tato kombinace je předložena „odpovídajícímu“ modelu. Ten nemusí být tak výkonný, protože dostává already lépe strukturovaný vstup.

Dvoufázový přístup má zásadní praktický přínos: umožňuje využít schopnost vyspělého modelu precizně formulovat otázky ve prospěch jednodušších, levnějších modelů. Experimenty ukázaly, že otázka přeformulovaná GPT-4 dokáže výrazně zlepšit výkon méně sofistikovaného modelu při generování odpovědí. Drahý model se tak stane jakýmsi „překladatelem“ mezi lidskou otázkou a méně schopným modelem.

Jak přeformulování probíhá v praxi?

Zajímavé je, že přeformulování není jednorázový akt. Experimenty ukázaly, že GPT-4 dokáže pojmy postupně objasňovat i tehdy, když se to nepodaří na první pokus. Po každém kole přeformulování se otázka stává propracovanější, přesnější a obsahuje více relevantního kontextu. Tento iterativní efekt připomíná spirálu porozumění – každé přeformulování přidává vrstvu jasnosti, až je otázka dostatečně konkrétní pro spolehlivou odpověď.

Prakticky to vypadá takto: původní lidská otázka může být stručná a implicitně obsahovat řadu předpokladů. Model ji přeformuluje tak, aby tyto předpoklady explicitně pojmenoval, upřesnil terminologii a doplnil kontext. Výsledná přeformulovaná otázka je delší a podrobnější – ale přesně to modelu umožňuje odpovědět správně a komplexně.

RaR versus Chain-of-Thought: v čem se liší?

RaR bývá přirovnáván k technice Chain-of-Thought (CoT) – myšlenkový řetězec – která také usiluje o zlepšení uvažování modelů. Obě techniky sdílejí snahu dostat model k přesnějším a hlubším odpovědím, ale přistupují k tomu z odlišných stran.

CoT žádá model, aby postupoval krok za krokem a zveřejnil svůj myšlenkový proces. Funguje dobře tam, kde je problém jasně definován a jde jen o to ho systematicky rozložit. RaR naproti tomu řeší situaci, kde samotná otázka není dostatečně jasná – pracuje tedy na jiné úrovni než CoT. Nejde o kroky v odpovědi, ale o kvalitu samotné otázky.

Výzkum ukázal, že RaR přináší zlepšení právě ve scénářích, kde je zero-shot CoT (tedy CoT bez ukázkových příkladů) neúčinné. Zároveň řeší některé inherentní nedostatky few-shot CoT, který je závislý na kvalitě zvolených ukázkových příkladů. RaR a CoT se tedy nepotírají – spíše pokrývají různé typy problémů a v určitých situacích je lze kombinovat.

Praktická aplikace: kdy RaR použít?

RaR má smysl zejména ve třech situacích. Za prvé, když pracujete s otázkami, které mohou být interpretovány více způsoby a přesnost odpovědi závisí na správné interpretaci. Za druhé, když potřebujete, aby méně výkonný model – například z důvodu nákladů nebo rychlosti – podával výsledky srovnatelné s dražším modelem. Za třetí, když budujete systémy, kde uživatelé nejsou experti na promptování a jejich otázky jsou přirozeně stručné a nestrukturované.

Pro práci v AI marketingu a content creation plyne z RaR jeden přímý závěr: pokud zadáváte modelu komplexní briefy nebo zadání, zvažte přidat do promptu instrukci, aby si model nejprve zadání vlastními slovy přeformuloval a potvrdil, jak ho pochopil – a teprve poté začal pracovat. Tímto jednoduchým krokem výrazně snížíte riziko, že model odpovídá na jinou otázku, než kterou jste položili.

RaR je tak v jistém smyslu formalizací toho, co dělají nejlepší lidští komunikátoři přirozeně: než odpovědí, ujistí se, že správně chápou otázku. A přesně tato zdánlivě banální schopnost dělá velký rozdíl mezi průměrnou a vynikající odpovědí.

Zdroj: Deng et al. Rephrase and Respond: Let Language Models Ask Better Questions Themselves. UCLA. | learnprompting.org

Tato metoda ukazuje, že LLM dokáže postupně objasňovat pojmy, i když se mu to nepodaří při prvním pokusu, přičemž otázky se po každém přeformulování stávají propracovanějšími.

Metoda RaR porovnávána s metodou myšlenkového řetězce (Chain-of-Thought, CoT) a ukazuje, že RaR nabízí zlepšení ve scénářích, kde je metoda CoT s nulovým počtem snímků neúčinná, a také řeší nedostatky vlastní metodě CoT s několika snímky.